Dalla messa online di ChatGPT circa un anno fa, quando di intelligenza artificiale si parlava pochissimo, al licenziamento di Sam Altman. Che cos'è Q-Star, in che modo supererebbe chatGPT e le altre intelligenze conversazionali. E perchè ha rischiato di spaccare il board di OpenAI.

Partiamo dalla fine. Che cos’è Q-Star (Q*).

Pare che Q* sia il progetto segreto che ha causato la rottura fra Sam Altman (CEO di OpenAI) e il consiglio direttivo (il “board” di OpenAI). Q* secondo le indiscrezioni sarebbe la prima AGI esistente al mondo, dove AGI vuol dire Artificial General Intelligence. Una nuova generazione di intelligenza artificiale, diversa dalle precedenti, più simile a quella umana, perché capace di generalità nella soluzione dei problemi. La caratteristica principale delle intelligenze artificiali sviluppate finora è che si tratta di narrow intelligence, cioè modelli generativi che sanno risolvere uno specifico set di problemi, ma non sono in grado di astrarre da quel problema e quindi non possono comprendere o imparare.

Q* sarebbe la prima AGI (se le voci sono vere) in grado di risolvere problemi matematici di livello elementare. Non è tanto rilevante la difficoltà dei problemi in sé, la cosa rivoluzionaria è che Q* ha un approccio generale al problema, non guidato, non verticale.

Q* sarebbe in grado di comprendere. E questo naturalmente pone problemi etici oltre che economici. Le conseguenze di questo tipo di tecnologia non sono facilmente prevedibili. Sembra che Q-Star sia la pietra della discordia a causa della quale Sam Altman il 17 Novembre 2023 è stato licenziato dal board di OpenAI.

Sam Altman, il deus ex-machina di chatGPT

Il licenziamento di Sam Altman

Il 17 Novembre 2023 il consiglio direttivo di OpenAI comunica in una call a Sam Altman di aver deciso il suo licenziamento, che poi sarà comunicato ufficialmente poco dopo sul blog di OpenAI. Il comunicato testuale recita: “La partenza del signor Altman segue un processo di revisione deliberativa da parte del consiglio, che ha concluso che egli non è stato costantemente sincero nelle sue comunicazioni con il consiglio, ostacolando la sua capacità di esercitare le proprie responsabilità. Il consiglio non ha più fiducia nella sua capacità di continuare a guidare OpenAI”.

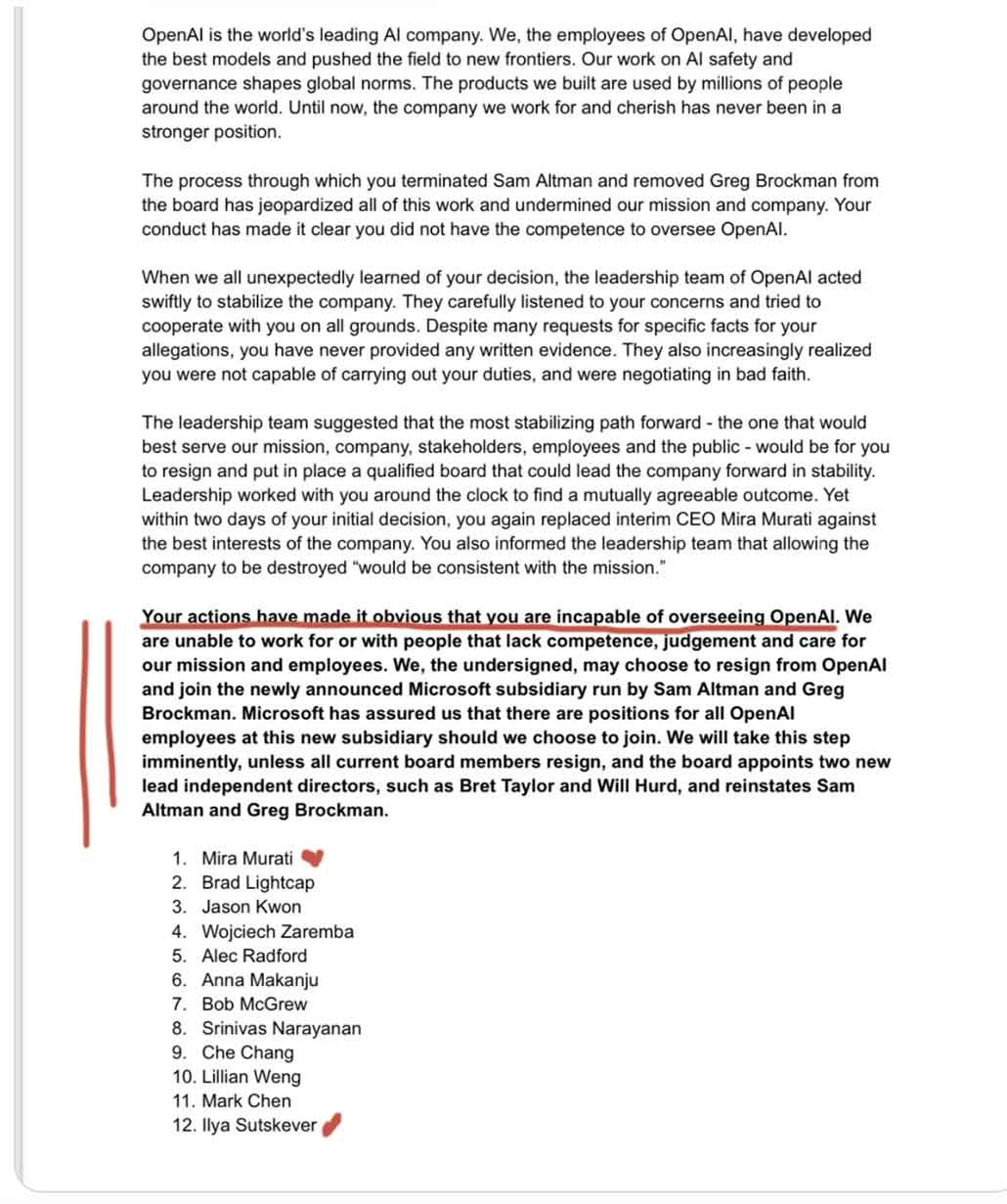

Al momento di queste decisioni il consiglio è formato dagli impiegati Greg Brockman (Presidente), Ilya Sutskever (chief scientist), Sam Altman (CEO), ai quali si affiancano come membri esterni Adam D’Angelo (ceo di Quora), Tasha McCauley (consulente per Rand, un’organizzazione vicina alla Difesa Americana), Helen Toner (principale antagonista di Altman, sostenitrice dell'approccio Altruismo Efficace, ritiene che le AGI spazzeranno via l’umanità). Questo gruppo di persone cerca di buttare fuori Sam Altman dalla compagnia, con l’appoggio di Sutskever; ma il golpe non funziona, perché sia Brockman che Mina Murati (un'altra interna di alto livello, nominata CEO ad interim dal board) restano fedeli ad Altman e si dimettono.

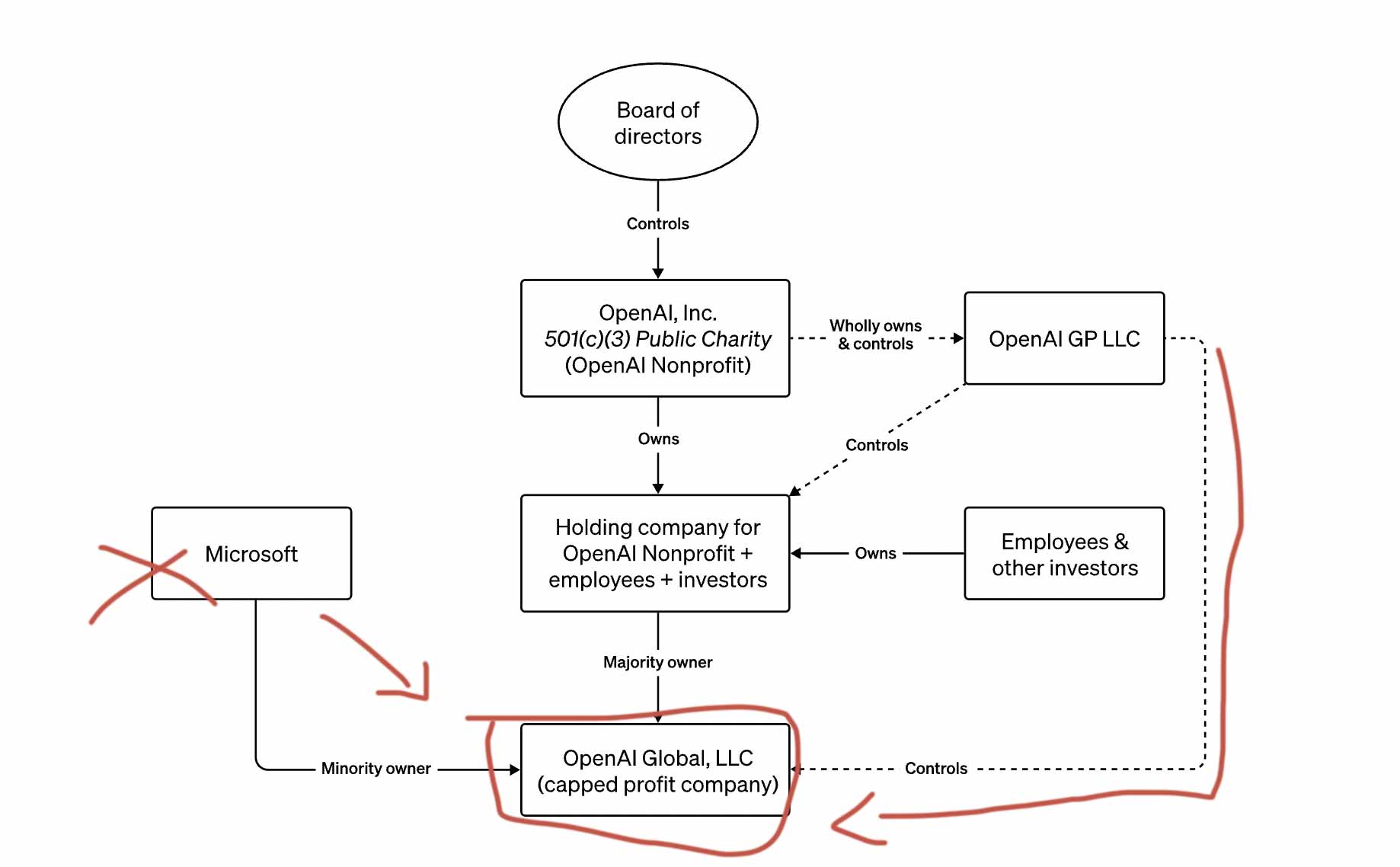

Solo pochi giorni dopo salta fuori una lettera firmata da circa 700 dipendenti OpenAI che minacciano di lasciare la compagnia, (per farsi assumere in Microsoft), dove nel frattempo Altman ha già trovato ospitalità sulla parola come CEO in una nuova unit creata ad-hoc per lui per lo sviluppo di intelligenza artificiale generativa. Teniamo anche presente che Microsoft ha investito circa 11 Miliardi di dollari (11 miliardi avete letto bene) in OpenAI e figura come minority owner di OpenAI LLC, che è una “capped profit company” creata nel 2019 da Altman per attrarre capitali di investimento.

La lettera dei 700 dipendenti OpenAI che minacciano di dimettersi in massa se Altman non sarà reintegrato

Quanto vale OpenAI in questo momento e quali sono gli interessi in gioco?

La valutazione attuale di OpenAI è intorno agli 80 miliardi di dollari. Questo la dice già lunga sugli interessi in gioco. Enormi, anche perché Microsoft sta basando il nuovo Bing su chatGPT, un’arma potentissima contro Google, che finora negli ultimi 20 anni è stato letteralmente irraggiungibile dai competitors. Ma il vento sembra stare girando, perché Bard (la versione Google di chatGPT) è ancora molto indietro rispetto a chatGPT, che invece in un anno ha fatto passi da gigante.

Quindi Microsoft ha 11 miliardi di buone ragione e anche molte di più per assicurarsi che il progetto prosegua e non naufraghi, e di sicuro l’appoggio di Nadella (Ceo di microsoft) & Friends è stato determinante per spostare l’ago della bilancia in questa storia, come vedremo fra poco.

Ma restiamo sulla storia. Ci sono due domande: in primis perchè il board di OpenAI si è spaccato? In secondo luogo perchè chatGPT in poco meno di 12 mesi è diventato così importante? Rispondiamo prima alla seconda domanda.

Mi occupo di sviluppo digitale, aiuto organizzazioni e aziende ad affrontare le sfide della digitalizzazione. Nell'ultimo anno mi sto interessando parecchio di intelligenza artificiale, principalmente per passione.

Info e contatti

Che cos’è chatGPT e che cosa ha fatto nell’ultimo anno?

ChatGPT è stato messo online il 30 Novembre 2022, e circa due mesi dopo è diventato l’applicazione con il più alto tasso di crescita di sempre (superata poi da Threads di Facebook che ha di recente raggiunto i 100 milioni di utenti in pochi giorni, però partendo da una base di utenti assai consolidata, quella di Meta). In ogni caso a due mesi dall’apertura chatGPT aveva raggiunto 100 milioni di utenti. Tik Tok ha impiegato circa 10 mesi per raggiungere questo traguardo, mentre Instagram due anni e mezzo (anche sei un’epoca molto meno digitalizzata). [Reuters, Studio UBS]

Tecnicamente chatGPT è un LLM, large language model. Si tratta di un modello linguistico capace di dialogare e generare linguaggio.

In breve: è un chatbot. Cioè un programma nel quale tu scrivi e ricevi risposte. Puoi chiedergli di fare diverse operazioni ma anche intrattenere ogni tipo di conversazione, perchè chatGPT sembra comprendere l’interlocutore. Ma la caratteristica importantissima che non dobbiamo perdere di vista è legata proprio al concetto di comprensione: chatGPT non comprende il linguaggio, non nel senso che intendiamo noi, non come farebbe un essere umano. chatGPT è un generatore di linguaggio basato sulla statistica. Questa cosa non è facile da trasferire, perché parlando con chatGPT si ha la sensazione di parlare con una persona, che capisce perfettamente le cose che noi le scriviamo e che quasi sempre riproduce delle emozioni di base, nel senso che è cortese, servizievole, estremamente disponibile.

ChatGPT non comprende il linguaggio, non nel senso che intendiamo noi, non come farebbe un essere umano. chatGPT è un generatore di linguaggio basato sulla statistica.

Ma queste caratteristiche umanizzate fanno parte del tuning del prodotto chatgpt; sono state perfezionate per rendere l’applicazione fruibile alla moltitudine. ChatGPT, anche al momento in cui scrivo (e a quanto sappiamo), non ha alcuna capacità emotiva o relazionale. Stiamo parlando di un modello linguistico che mette in fila gruppi di lettere come un fabbro farebbe con dei pezzi di metallo, basandosi solo e soltanto sulla probabilità statistica che a ciascun gruppo di lettere ne segua un altro, in un determinato contesto di significato.

La struttura societaria di OpenAI, che è stata fondata come organizzazione no-profit nel 2015 da Sam Altman. In seguito nel 2019 lo stesso Altman ha creato la OpenAI LLC (una compagnia con tetto ai profitti) per attrarre investimenti

Come ha fatto chatGPT a imparare a parlare?

I modelli linguistici sono addestrati in 4 fasi: pre-training, calibratura, ricompensa e valutazione.

Il pre-traininig lo ha imparato da noi. Noi esseri umani. Gli sono state somministrate enormi quantità di testi presi da fonti selezionate più o meno in questa configurazione:

- Libri (saggistica, romanzi) 15%;

- Wikipedia 5%,

- Pagine web e social (principalmente Reddit) 20% (preziosissime perchè catturano le conversazioni informali e quindi riproducono ambienti conversazionali);

- altre fonti internet non meglio identificate per circa il 6o%).

Stiamo parlando di un pre-training su una quantità di dati che non è facile da concepire ma comunque un essere umano non potrebbe riuscire ad assorbirle pur dedicandovi tutta la vita. Esempio concreto: circa 50 miliardi di frasi da pagine web. Se ogni giorno utilizzassi 24 ore per leggere e memorizzare una frase al minuto, potrei farne 60x24, cioè circa 1500 al giorno, quindi 500mila frasi all’anno. Per raggiungere 45 miliardi mi servirebbero 90mila anni. Novantamila anni. Non non mille anni, non diecimila: quasi centomila anni.

Per assorbire gli stessi dati su cui ha fatto pre-training chatGPT, una persona avrebbe bisogno di circa novantamila anni

Dopo il pre-training c’è la calibratura. Sempre utilizzando algoritmi matematici, si affina la capacità del modello di selezionare un linguaggio il più possibile delimitato all’interno dei confini del significato.

Poi il fine tuning, quindi la raffinazione del risultato finale avviene con il sistema della ricompensa, ovvero su un set di dati meno ampio e più delimitato le risposte vengono etichettate, in modo da ottimizzare l’accuratezza delle risposte.

Tutto questo accade sempre nel canovaccio del model evaluation, la valutazione. La valutazione non si ferma mai, anche quando parla con noi il modello apprende dall’interazione. E questo gli permette di continuare a evolversi.

Però stiamo parlando sempre di un modello linguistico che non comprende. Potenti ed efficaci nelle prestazioni, i modelli linguistici come chatGPT (e anche BERT di Google per esempio) non comprendono quello che noi diciamo loro. Sono "solo" dei supermagazzini di dialoghi che avendo scomposto miliardi di conversazioni, hanno la capacità statistica di mettere insieme i lemmi, i singoli pezzi delle parole, e associarli generando linguaggio effettivo.

Questa cosa è incredibile e affascinante. In primis perchè funziona; in secondo luogo perchè dimostra una cosa difficile da comprendere oggi, cioè che non per forza bisogna capire di cosa si sta parlando, per poterne parlare. E io credo che questo avrà implicazioni future sulla coscienza umana e sulle forme dell’apprendimento, quando arriverà il momento.

Ma restiamo su chatGPT: non capisce, non in senso umano, eppure sa rispondere. E invece Q*? Q-Star sembra aver superato i modelli linguistici, Q* sarebbe un’intelligenza generalista, almeno stando a quanto afferma Altman (a questo proposito OpenAI si sarebbe rifiutata di far fare una valutazione indipendente di questa tecnologia a Reuters, per motivi di segretezza). In ogni caso questo può aiutarci a rispondere alla prima domanda, cioè perchè il board di OpenAI ha cercato di fare fuori Sam Altman.

Lo scontro “etico” e le 3 anime che convivono dentro OpenAI

Premesso che non possiamo sapere se oltre allo scontro etico ci siano altre motivazioni più “materiali”, visti gli interessi economici in campo, c’è un problema di fondo che ha diviso i protagonisti di questa storia.

In OpenAI a quanto è dato sapere convivono tre diverse anime, che hanno una diversa visione di quello che sta accadendo e di dove dovrebbe andare la “missione” AI.

In primis ci sono gli “altmaniani” (e sembrano essere la maggioranza peraltro) che seppur con sfumature hanno fiducia nel progresso delle intelligenze artificiali e vogliono portarlo subito alla sua massima realizzazione: lo sviluppo di una AGI, un’intelligenza artificiale generale.

Helen Toner, che fra le altre cose sostiene che le intelligenze artificiali siano un pericolo per l'umanità

Dall’altra parte c’è invece un gruppo (i catastrofisti, a torto o a ragione) che porrebbe maggiore attenzione ai rischi sulla sicurezza e che quindi vorrebbe rallentare lo sviluppo di questa tecnologia ed avere più tempo per testarla e comprenderla in un ambiente protetto. A questa fazione appartengono Ilya Sutskever (capo scientifico di OpenAI) e Helen Toner, membro del board, nonché principale portatrice della voce di organizzazioni terze che ritengono l'intelligenza artificiale possa arrivare a cancellare l’umanità.

Ilya Sutskever, scinetific chief di OpenAI, che ha inizialmente votato il licenziamento di Altman e poi ha ritrattato

C’è poi una terza fazione, più moderata, (i semiconduttoridi, li ho ribattezzati) che crede in uno sviluppo immediato ma più controllato (realizzabile, dicono, limitando la tecnologia dei semiconduttori, quindi la potenza di calcolo per non permettere un’evoluzione incontrollata delle AGI).

Sembra la trama di un film, invece sta succedendo tutto per davvero proprio in questi giorni ed è chiaro che le fazioni 1 e la 3 stanno avendo la meglio, almeno al momento. Infatti Altman viene reintegrato dopo 5 giorni.

Il reintegro di Altman e il nuovo board

Risultato finale di questa telenovela: per adesso vincono gli Altmaniani. Cinque giorni dopo il licenziamento, il 22 Novembre 2023, Sam Altman viene reintegrato in OpenAI e il board sostanzialmente rimpastato. Tasha McCauley e Helen Toner, le principali oppositrici, sono epurate, mentre Ilya Sutskever resta in sella, con un dietro-front acrobatico su Twitter (dove si dice dispiaciuto, non voleva davvero licenziare Altman, salviamo la compagnia insieme ecc. ecc.).

Subentrano invece come nuovi membri esterni Bret Taylor in posizione di chairman, già precedentemente co-CEO in Salesforce e membro del Twitter board prima dell’avvento di Elon Musk; e poi c’è Larry Summers, precedentemente segretario del Tesoro U.S.A., quindi sicuramente un uomo vicino agli ambienti governativi, anche perchè questa situazione non starà certo sfuggendo alla Casa Bianca. Resta infine in sella anche Adam D’Angelo, che pure aveva votato contro Altman, ma che è giudicato una figura più indipendente, essendo un informatico riconosciuto nella scena statunitense al momento.

Ed ora il palcoscenico è di nuovo aperto per Altman. Resta da capire se nei prossimi giorni o settimane Q* sarà davvero rivelata al mondo oppure no. Stay tuned, dicono gli americani.

Fonti e riferimenti

- https://www.reuters.com/technology/sam-altmans-ouster-openai-was-precipitated-by-letter-board-about-ai-breakthrough-2023-11-22/

- https://www.washingtonpost.com/technology/2023/11/20/openai-sam-altman-ceo-oust/

- https://www.theguardian.com/technology/2023/nov/20/whats-been-going-on-at-the-company-behind-chatgpt-and-why-it-matters-openai

- https://time.com/6338789/sam-altman-openai-return-timeline/

- https://www.ansa.it/osservatorio_intelligenza_artificiale/notizie/approfondimenti/2023/11/24/openai-la-parabola-di-altman-e-lo-svelamento-di-qnbsp_4c88b05e-5536-41f6-9390-180e646dca5c.html

- https://www.reuters.com/technology/chatgpt-sets-record-fastest-growing-user-base-analyst-note-2023-02-01/

- https://www.wired.it/article/intelligenza-artificiale-generativa-scraping-addestramento-dati-chatgpt-midjourney/

- https://www.internazionale.it/ultime-notizie/2023/11/22/usa-openai-altman-ritorno

- https://www.bigdata4innovation.it/intelligenza-artificiale/training-di-chatgpt-come-vengono-addestrati-i-modelli-di-ai/

- https://www.spiceworks.com/tech/artificial-intelligence/articles/what-is-narrow-ai/

Faccio seo dal 1969, quando l'uscita di Abbey Road trasformò il modo di fruire la musica. Sono un data driven scout, il mio lavoro è portare traffico qualificato sui siti web. Ho una laurea110L con tesi in sistemi economici comparati e un bellissimo computer. Faccio sport e guardo molto cinema.

Richiedi info